白话Attenction机制

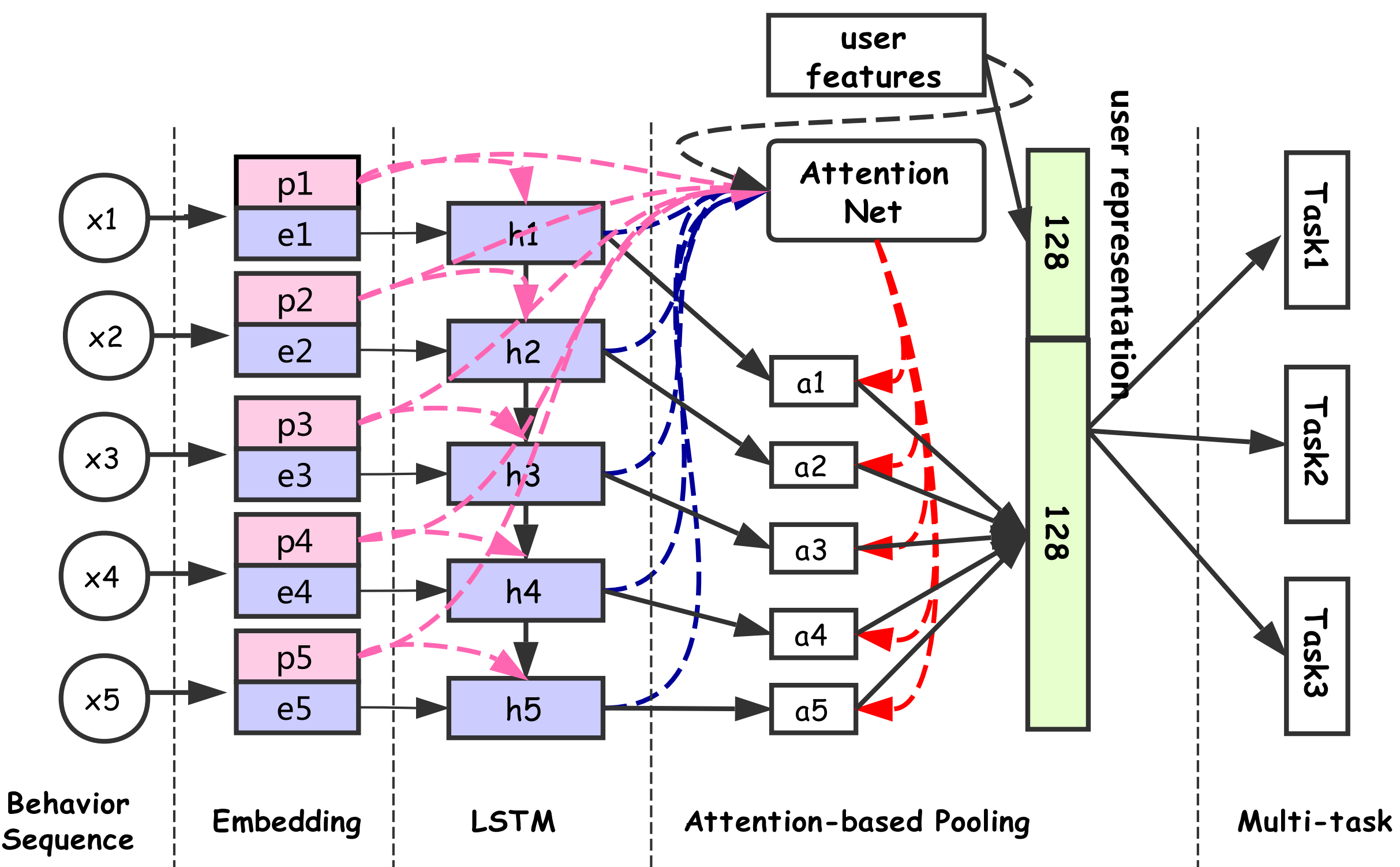

attention机制最初是在 rnn 中引入的用于解决机器翻译问题,此前机器翻译问题通过使用 RNN 解决,先基于输入编码一个隐语义向量,然后通过解码器基于该隐语义向量进行解码。但是这样存在一个问题,就是解码严重依赖于同一个隐语义向量。仔细思考下这样是不合理的。因为对于不同的输出 $y_i$,其和输入$X=\lbrace x_1, x_2,.., x_n \rbrace$有着不同的相关性,例如将“我爱你”翻译成“I love you”,显然输入“我“,”爱“,”你”对输出 $I$的贡献是不同的。attention就是为了解决这个问题,总结就是为了解决信息传递过程中的信息量不同的情况。